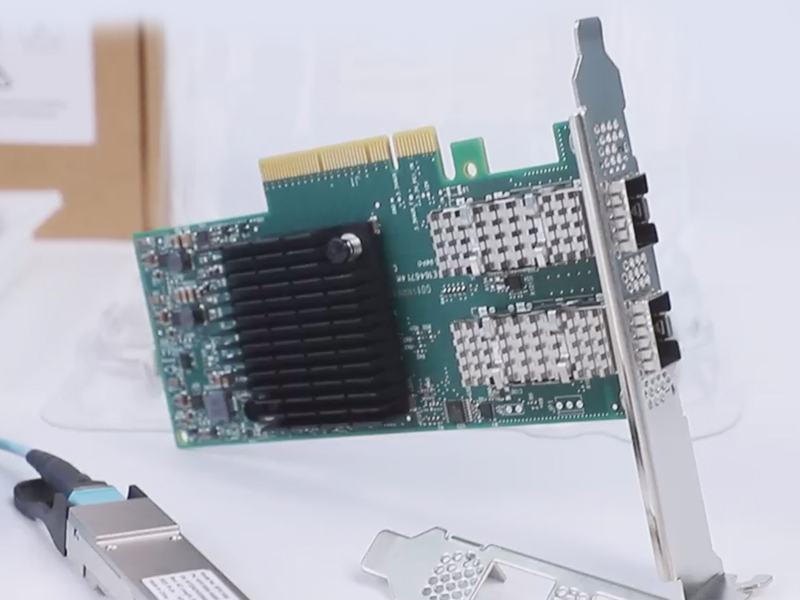

针对需要高可用网络或多平面隔离的 HPC 与 AI 训练集群,MCX755106AS-HEAT 提供了双 QSFP 端口设计。基于 NVIDIA ConnectX-7 架构,这张 HHHL 卡在支持 400Gb/s InfiniBand 吞吐的同时,允许用户通过双端口实现链路聚合、网络冗余或分离数据与存储流量,而无需额外占用 PCIe 插槽。

主要特征

- 双端口灵活组网 — 板载 2 个 QSFP cages,支持双端口 200Gb/s 独立工作或绑定为 400Gb/s 带宽,适用于双平面网络架构或实现 2x 200G 的链路聚合,提升集群可靠性与吞吐密度。

- 双协议与向后兼容 — 支持 InfiniBand (NDR/HDR/EDR) 和以太网 (400GbE/200GbE/100GbE/50GbE/25GbE/10GbE) 双协议。双端口模式下可分别连接 InfiniBand 计算网与以太网存储/管理网,实现异构融合。

- 计算与存储加速 — 内置 NVIDIA 网络计算引擎,支持 GPUDirect RDMA 与 GPUDirect Storage,消除数据在 GPU 与存储之间的拷贝延迟。同时支持 NVMe-oF 硬件卸载及 T10-DIF 签名传递,提升存储节点效率。

- 硬件级安全卸载 — 提供 IPsec、TLS 和 MACsec 的内联加密/解密引擎 (AES-GCM 128/256-bit),实现数据在传输中、传输层及链路层的加密,同时释放 CPU 资源。支持基于硬件根信任的安全启动与安全固件更新。

- PCIe Gen5 主机接口 — 采用 PCIe 5.0 x16 接口,单端口 400Gb/s 或双端口 200Gb/s 流量均可获得充足的主机带宽。支持 PCIe 4.0/5.0 自适应,兼容现有服务器平台。

- 精准时间同步 — 集成 IEEE 1588v2 (PTP) 与 SyncE,支持 G.8273.2 Class C 标准,提供低至 12 纳秒的硬件时间戳精度,适用于高频交易、电信及分布式计算场景。

规格明细

| Feature | Specification |

|---|---|

| 型号 | MCX755106AS-HEAT |

| 支持的协议 | InfiniBand, Ethernet |

| InfiniBand 速率 | NDR 400Gb/s, HDR 200Gb/s, EDR 100Gb/s |

| 以太网速率 | 400GbE, 200GbE, 100GbE, 50GbE, 25GbE, 10GbE |

| 端口数量 | 2 |

| 端口类型 | QSFP |

| 主机接口 | PCIe Gen 4.0/5.0 x16 (支持扩展选项) |

| 卡型规格 | HHHL (半高半长) |

| RoCE | 支持 (RDMA over Converged Ethernet) |

| InfiniBand 特性 | XRC, DCT, Adaptive Routing, SHARP 卸载, 突发缓冲卸载 |

| 安全加速 | IPsec (内联), TLS (内联), MACsec (内联), 安全启动, 闪存加密 |

| 存储卸载 | NVMe-oF, NVMe/TCP, iSER, SRP, NFS over RDMA, SMB Direct |

| 虚拟化 | SR-IOV, VirtIO 加速, PASID, ATS, ACS |

| 时间同步 | IEEE 1588v2 (PTP, UTC 格式), SyncE (G.8262.1), 12ns 精度 |

| 操作系统支持 | Linux (RHEL, Ubuntu), Windows, VMware ESXi (SR-IOV), Kubernetes |

| 管理标准 | NC-SI, MCTP, PLDM (DSP0248/0267/0218/0257), SPDM |

| 远程启动 | InfiniBand 远程启动, iSCSI, UEFI, PXE |

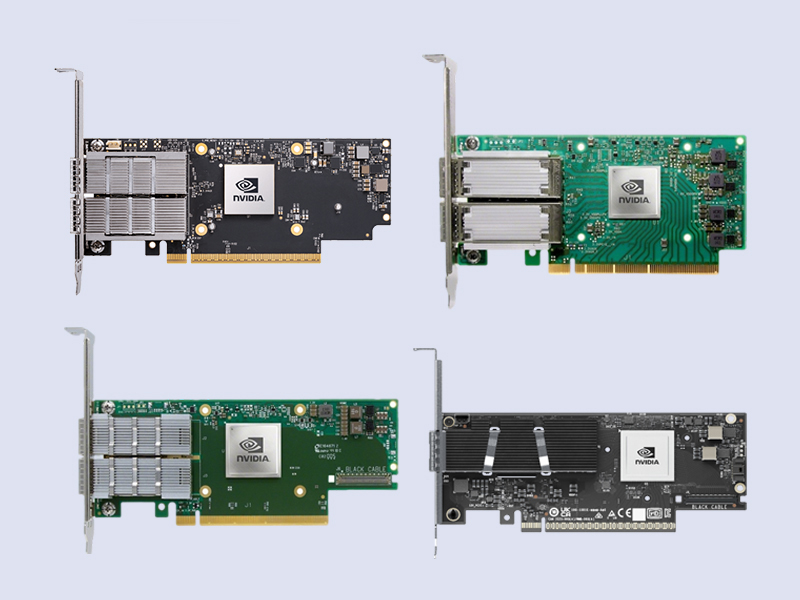

同系型号 (ConnectX-7 InfiniBand 适配器系列)

| Orderable Part Number (OPN) | Description | Key Differentiator |

|---|---|---|

| MCX75510AAS-NEAT | 单端口 OSFP, PCIe Gen4/5 x16, HHHL, 支持 400Gb/s InfiniBand | 最大吞吐密度,适用于 GPU 服务器主计算网 |

| MCX75310AAS-NEAT | 单端口 OSFP, PCIe Gen4/5 x16, HHHL, 支持 400Gb/s InfiniBand | 与 75510 类似,基础款 400G 连接 |

| MCX75210AAS-NEAT | 单端口 OSFP, PCIe Gen4/5 2x8 上行, HHHL, 支持 400Gb/s InfiniBand | 双 PCIe 控制器设计,适用于多主机或特殊拓扑 |

| MCX75510AAS-HEAT | 单端口 OSFP, PCIe Gen4/5 x16, HHHL, 支持 200Gb/s InfiniBand | 200G 速率优化,兼顾性能与功耗 |

| MCX75310AAS-HEAT | 单端口 OSFP, PCIe Gen4/5 x16, HHHL, 支持 200Gb/s InfiniBand | 200G 连接,与 75510 同属单端口 OSFP 家族 |

| MCX75210AAS-HEAT | 单端口 OSFP, PCIe Gen4/5 2x8 上行, HHHL, 支持 200Gb/s InfiniBand | 200G 速率 + 双 PCIe 控制器,适合多主机接入 |

| MCX755105AS-HEAT | 单端口 QSFP, PCIe Gen4/5 x16, HHHL, 支持 200Gb/s InfiniBand | 单 QSFP 端口,兼容现有 QSFP 光模块布线 |

| MCX755106AS-HEAT | 双端口 QSFP, PCIe Gen4/5 x16, HHHL, 支持 2x 200Gb/s InfiniBand | 双端口设计,支持链路聚合或网络平面隔离 |

服务与支持

- 免费方案设计 — 根据客户应用场景提供网络架构建议与配置指导。

- 选型报价 — 快速响应,提供详细的配置清单与商务报价。

- 现场调试 — 专业工程师支持现场安装与初期调优服务。

- 原厂质保 — 1 年硬件保修,享受 NVIDIA 官方售后支持。

常见问题 (FAQ)

Q: MCX755106AS-HEAT 的双端口支持哪些工作模式?

A: 两个 QSFP 端口均支持独立的 InfiniBand 或以太网模式。常见部署场景包括:两个端口同时连接 InfiniBand 交换机实现链路聚合 ( bonding ) 或主备冗余;或者一个端口接入 InfiniBand 计算网,另一个端口接入以太网存储/管理网,实现数据平面分离。

Q: 这张卡是否兼容 QSFP 模块的 100G 和 50G 速率?

A: 是的,两个 QSFP 端口均支持向下兼容。在 InfiniBand 模式下支持 HDR (200G) 和 EDR (100G);在以太网模式下支持 200GbE、100GbE、50GbE、25GbE 和 10GbE,可以根据现有交换机端口速率灵活配置。

Q: 双端口同时满载 200G 流量时,PCIe Gen4 x16 接口会否成为瓶颈?

A: PCIe Gen4 x16 提供的双向带宽约为 256Gb/s,略高于双端口 400Gb/s 总吞吐量。实际应用中,双端口同时持续满载可能会遇到 PCIe 带宽限制。建议搭配 PCIe Gen5 x16 插槽使用(此卡支持 Gen5),可获得 512Gb/s 带宽,完全释放双 200G 端口的性能。

Q: 与单端口 OSFP 型号 (如 MCX75510AAS-HEAT) 相比,双端口 QSFP 卡的主要优势是什么?

A: 主要优势在于灵活性和冗余。双端口设计允许单台服务器同时接入两个独立网络,例如一个用于 MPI 通信,一个用于 I/O 存储。或者在关键节点实现网络路径冗余,任意一条链路中断不影响业务。OSFP 单端口卡则更侧重于单连接 400G 的最大速率。

MCX755106AS-HEAT Mellanox NVIDIA ConnectX-7 NDR 200Gb/s双端口QSFP112 IB 网卡 选型、兼容与采购说明

围绕 NVIDIA ConnectX InfiniBand网卡 RDMA选型,本页补充 MCX755106AS-HEAT Mellanox NVIDIA ConnectX-7 NDR 200Gb/s双端口QSFP112 IB 网卡 的应用场景、参数选型、兼容性确认、企业采购报价和替代型号沟通信息,帮助客户在搜索“MCX755106AS-HEAT Mellanox NVIDIA ConnectX-7 NDR 200Gb/s双端口QSFP112 IB 网卡 参数”“MCX755106AS-HEAT Mellanox NVIDIA ConnectX-7 NDR 200Gb/s双端口QSFP112 IB 网卡 报价”“MCX755106AS-HEAT Mellanox NVIDIA ConnectX-7 NDR 200Gb/s双端口QSFP112 IB 网卡 兼容性”“NVIDIA ConnectX InfiniBand网卡 RDMA选型 选型”时更快判断是否适合当前项目。

应用场景与项目需求

重点适用于 AI 训练服务器、GPU 集群、HPC 高性能计算、InfiniBand/RDMA 网络和数据中心高速互联项目,常见咨询包括速率、PCIe 规格、单/双端口、交换机端口匹配和驱动/固件兼容。

参数选型与替代型号

选型时建议同时确认 ConnectX 系列、端口速率、PCIe 代际与通道、服务器插槽、操作系统环境、交换机型号、线缆或光模块规格,并预留后续扩容和替代型号空间。

兼容性确认与报价沟通

兼容性建议围绕服务器品牌型号、主板插槽、GPU 节点数量、InfiniBand 交换机端口、线缆/光模块接口和 RDMA 应用环境逐项确认。 如需报价,建议同时提供数量、使用场景和期望交期。